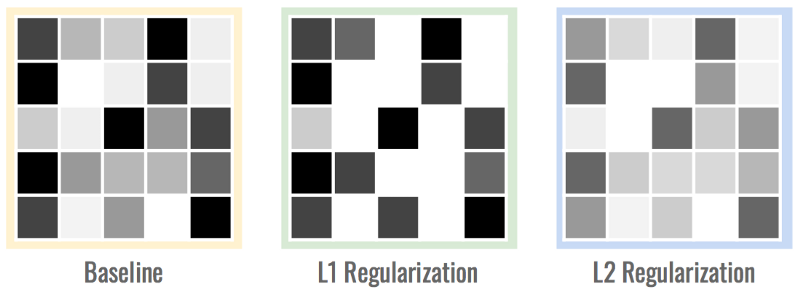

L1正则化和L2正则化 - Peyton_Li

323x303 - 37KB - PNG

L1正则化与L2正则化产生稀疏解示意图

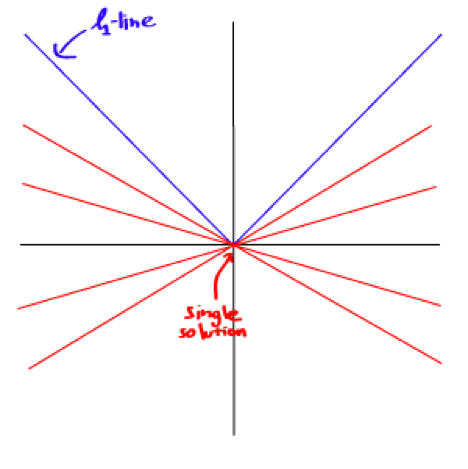

417x237 - 31KB - JPEG

机器学习中正则化项L1和L2的直观理解_「电脑

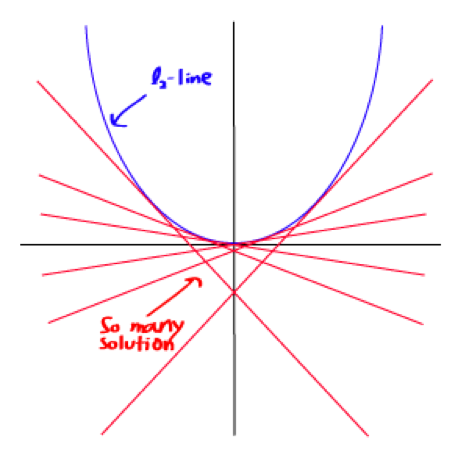

318x297 - 32KB - PNG

机器学习中正则化项L1和L2的直观理解 - 综合

318x297 - 33KB - PNG

机器学习中用来防止过拟合的方法有哪些?

800x294 - 33KB - JPEG

机器不学习:深度学习训练淫技2 L1正则化和L2正则化

640x300 - 20KB - JPEG

L1正则和L2正则的比较分析详解

468x469 - 44KB - PNG

L1正则和L2正则的比较分析详解

469x469 - 56KB - PNG

正则化方法:L1和L2 regularization、数据集扩增

310x324 - 10KB - PNG

教程 | 初学者如何学习机器学习中的L1和L2正则化

715x715 - 268KB - JPEG

谈谈 L1 与 L2-正则项

506x506 - 40KB - JPEG

斯坦福完全可解释深度神经网络:你需要用决策

1327x742 - 173KB - JPEG

斯坦福完全可解释深度神经网络:你需要用决策

1327x742 - 173KB - JPEG

腾讯AI Lab现场陈述论文:训练L1稀疏模型的象

640x488 - 28KB - JPEG

机器学习中的逻辑回归模型简介 - 博客 - 伯乐在

349x345 - 46KB - JPEG

在经验风险上加一个正则项或罚项,正则项一共有两种L1正则化和L2正则化,或者L1范数和L2范数。对于线性回归

摘要:本文主要分为三部分,先讲述什么是正则化,再讲L1和L2正则化数学原理,最后小结对比。一、什么是正则

L1正则化的解具有 稀疏性,可用于 特征选择。L2正则化的解都比较小,抗扰动能力强。L2正则化 对模型参数 的

一般英文称作ℓ1ℓ1\ell_1-norm和ℓ2ℓ2\ell_2-norm,中文称作L1正则化和L2正则化,或者L1范数和L2范数。

正则化是一种回归的形式,它将系数估计(coefficient estimate)朝零的范数 L1范数当p=1时,是L1范数,其

L1正则化,又叫Lasso Regression 如下图所示,L1是向量各元素的绝对值之和L2正则化,又叫Ridge Regression

一般英文称作ℓ1-norm和ℓ2-norm,中文称作L1正则化和L2正则化,或者L1范数和L2范数。L1正则化和L2正则化

使用L1和L2正则化的使用,在许多代价函数中经常出现,也许你知道了L1会产生稀疏解,L2会防止过拟合之类的