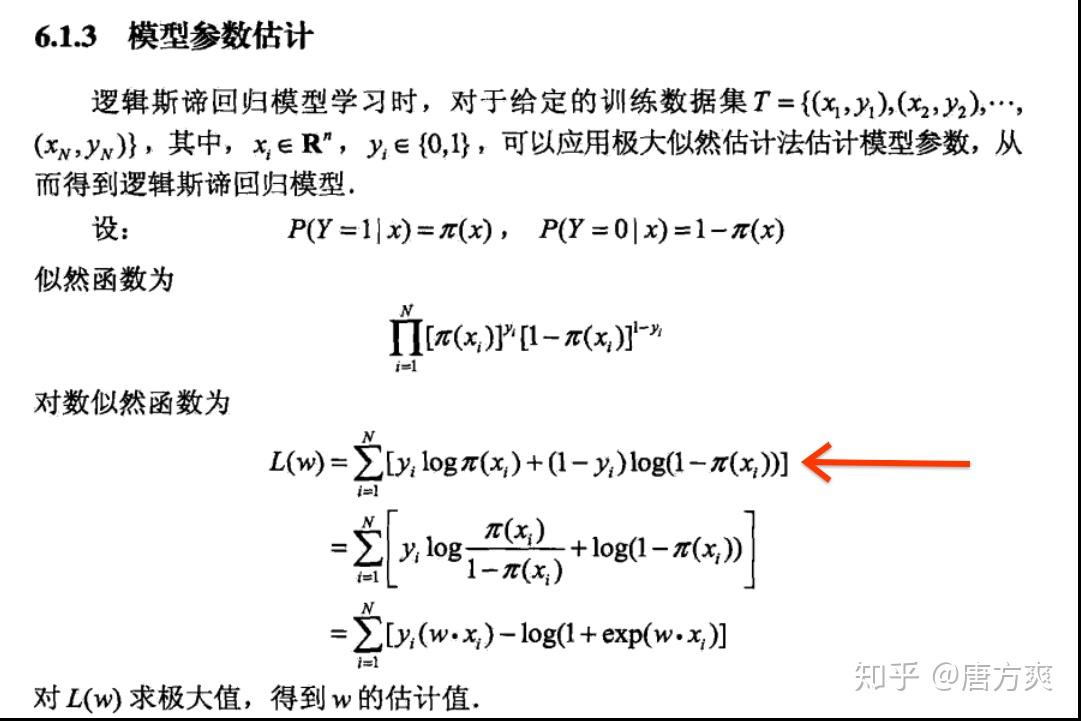

同理,应对多分类问题的交叉熵损失函数本质上为假设数据服从以模型输出为参数的多项分布的极大似然估计。而应对回归问题时, Loss和 Loss均可用极大似然估计法推得, 和

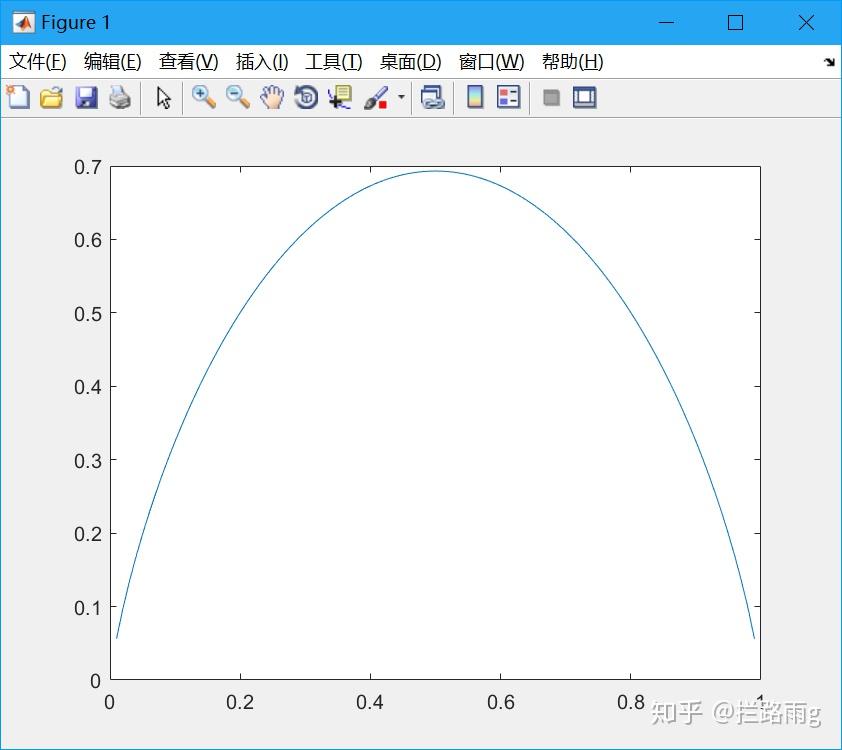

在很多二分类问题中,特别是正负样本不均衡的分类问题中,常使用交叉熵作为loss对模型的参数求梯度进行更新,那为何交叉熵能作为损失函数呢,我也是带着这个问题去找解析的

交叉熵是用来衡量两个概率分布的距离(也可以叫差别)。[概率分布:即[0.1,0.5,0.2,0.1,0. 假设有一个三分类问题,某个样例的正确答案是(1,0,0),某个模型经过softmax回归之后的

交叉熵可在神经网络(机器学习)中作为损失函数,p表示真实标记的分布,q则为训练后的模 其中,C代表类别数。p代表向量形式的模型参数,即各个类别的发生概率,如p=[0.1, 0.1, 0

计算加权交叉熵。 计算 logits和 labels之间的 softmax交叉熵。 测量类别相互排斥的离散分类任务中的概率(每个条目恰好在一个类别中)。(有一个且只有一个标签:图像可以是狗

简介:语言模型的性能通常用交叉熵和复杂度(perplexity)来衡量。交叉熵的意义是用该模型对文本识别的难度,或者从

关于categorical cross entropy和 binary cross entropy的比较,差异一般体现在不同的分类(二分类、多分类等)任务目标,可以参考文章keras中两种交叉熵损失函数的探讨,其结合k

简介:期望交叉熵,一种常用的特征选择的算法。以文本分类为例,期望交叉熵用来度量一个词对于整体的重要程度。

function f=CERF(h1,h2)%CERF return CERF(交叉熵)求两图像的交叉熵%input must be a imagehandle输入图像句柄%image fusion evaluate parameter图像融合评价参数% exa

注意:tensorflow交叉熵计算函数输入中的logits都不是softmax或sigmoid的输出,而是soft 它适用于每个类别相互独立但互不排斥的情况:例如一幅图可以同时包含一条狗和一只大

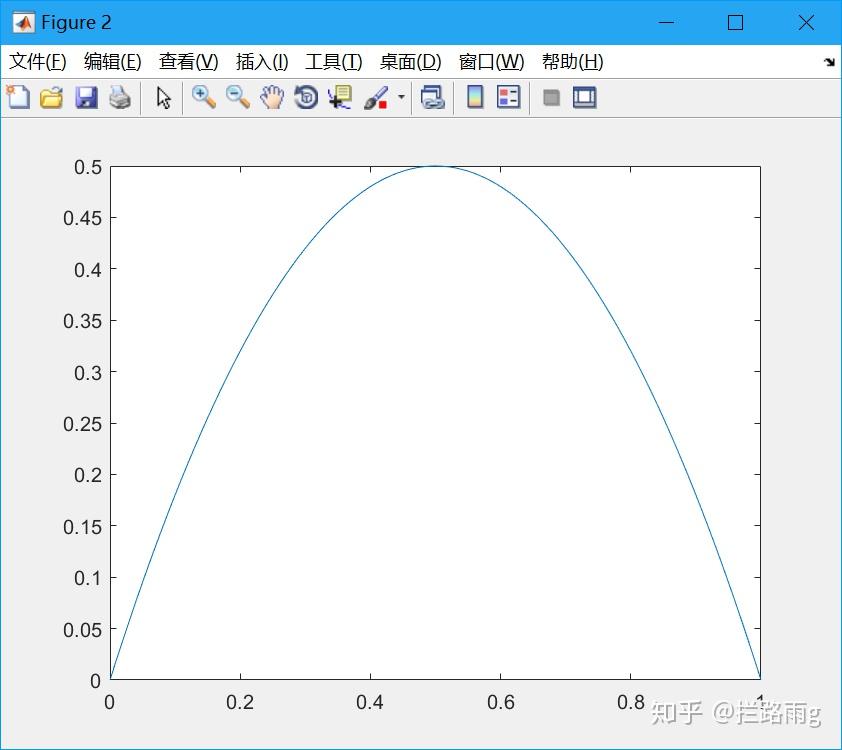

交叉熵作为分类任务的损失函数,去掉log是否可

842x750 - 69KB - JPEG

交叉熵作为分类任务的损失函数,去掉log是否可

842x750 - 73KB - JPEG

为什么逻辑回归的损失函数叫做交叉熵呢?

1081x721 - 121KB - JPEG

多伦多大学联手Uber推出RevNet,不用存储激活

640x240 - 23KB - JPEG

多分类问题的交叉熵

620x260 - 31KB - JPEG

基于交叉熵的病毒式移动通信系统性能研究-控

800x1131 - 71KB - PNG

基于交叉熵理论的配电变压器寿命组合预测方法

800x1131 - 60KB - PNG

交叉熵图像处理.ppt

1280x720 - 113KB - PNG

交叉分类法定义 - 蓝讯

280x220 - 16KB - JPEG

5.1 莫烦 Python Classification 分类学习

300x327 - 17KB - JPEG

莫烦 Python Classification 分类学习

311x339 - 16KB - PNG

关于贝叶斯分类问题的一些思考和实践

596x657 - 67KB - JPEG

如何用深度学习做图像分类?教给你教程和代码

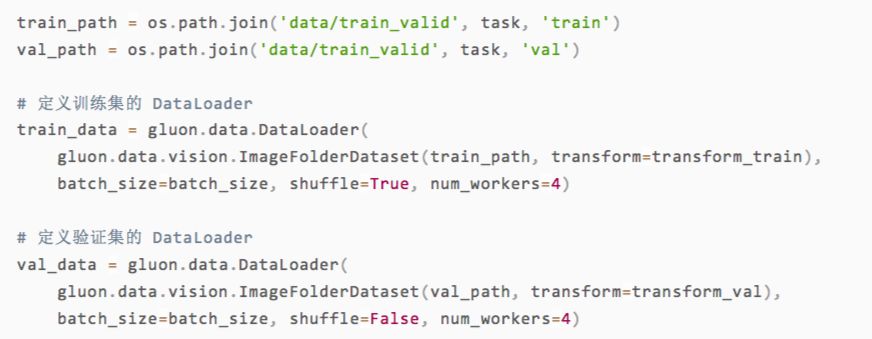

872x339 - 33KB - JPEG

工程管理熵学及其应用.pdf全文-毕业论文-在线

800x1168 - 287KB - PNG

理解交叉熵作为损失函数在神经网络中的作用_

325x197 - 10KB - PNG