信息熵:理论与应用:亚马逊:图书

1077x1513 - 202KB - JPEG

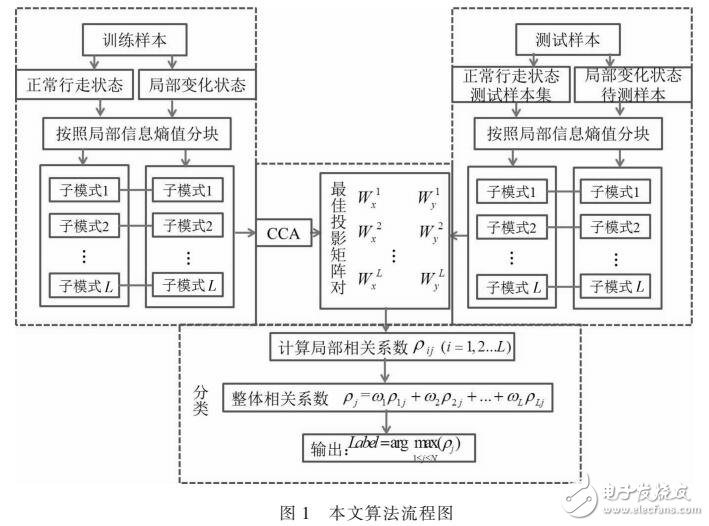

基于局部信息熵值的子模式划分方法-电子电路

709x526 - 71KB - JPEG

检测多元相关关系的最大信息熵方法.pdf全文-综

800x1149 - 501KB - PNG

信息的度量--信息熵 - 今日头条(www.toutiao.co

478x264 - 12KB - JPEG

基于分形维数和信息熵的土地利用景观格局变化

1276x1684 - 112KB - PNG

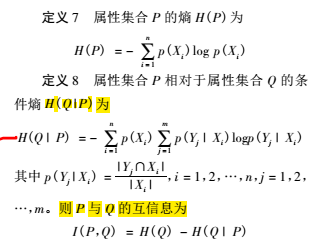

粗糙集条件信息熵和互信息怎么计算的?有公式

317x242 - 33KB - JPEG

实验一信息熵与图像熵计算解读.docx

141x200 - 13KB - PNG

【信息熵经济学(人类发展之路) 正版 鲍际刚\/\/夏

800x800 - 76KB - JPEG

机器学习中决策树的原理与算法 | 科普

534x380 - 31KB - JPEG

关于信息熵的几个现实意义.doc

794x1123 - 45KB - PNG

2.信息熵的起源.doc

993x1404 - 114KB - PNG

信息熵及其应用材料.ppt

1152x864 - 5KB - PNG

平均信息熵及其应用 幻灯片.ppt

1152x864 - 41KB - PNG

信息熵-特征选方案.doc

993x1404 - 79KB - PNG

快递企业竞争力香农信息熵综合评价法应用研究

1414x2027 - 1152KB - PNG

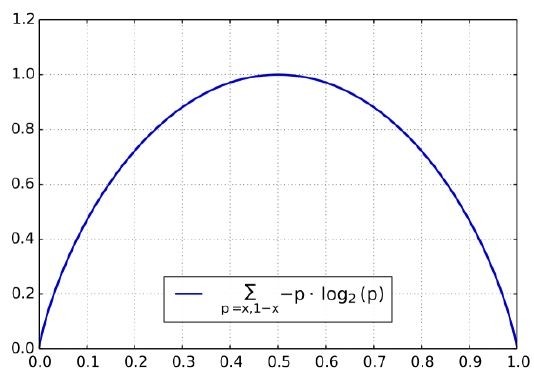

根据香农(Shannon)给出的信息熵公式,对于任意一个随机变量X,它的信息熵定义如下,单位为比特(bit):

香农把它称为“信息熵”(Entropy),一般用符号 H 表示,单位是比特。有兴趣的读者可以推算一下当 32 个球队

直到1948年,香农提出了“信息熵”的概念,才解决了对信息的量化度量问题。信息熵这个词是C.E.香农从热力

信息量的基本单位是()A.比特B.信息熵C.dbD.无单位请帮忙给出正确答案和分析,谢谢!

香农把它称为“信息熵”(Entropy),一般用符号 H 表示,单位是比特。有兴趣的读者可以推算一下当 32 个球队

信息熵的单位为bit。 首先定义时间 的 信息量 为其发生概率对数的负数,记为,有: 由该定义可得,为

信息熵的单位与公式中对数的底有关。最常用的是以2 位为比特(bit);在理论推导中常采用以e为底,单位为奈特

相信通过这个回答的介绍,能够使一个对信息熵毫无了解的人,基本上明白信息熵是什么,以及有什么用。

式中的b是对数的底,b的取值决定信息熵的单位,如b取2信息量的单位是bit,b取自然常数e信息量的单位是nat,