技术漫谈|搭建自己的ceph RBD

640x568 - 47KB - JPEG

Rancher如何对接Ceph-RBD块存储

581x242 - 9KB - JPEG

ceph在品高云中的实践-爱编程

903x370 - 26KB - JPEG

Ceph源码解析:读写流程_服务器应用_Linux公社

627x281 - 39KB - JPEG

Rancher如何对接Ceph-RBD块存储

586x243 - 9KB - JPEG

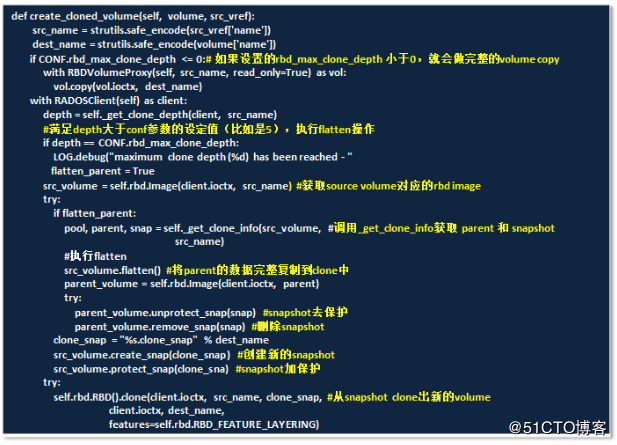

别让bug跑了,通过问题理解ceph的克隆过程

617x445 - 100KB - JPEG

Ceph块设备管理与Openstack配置(上)

716x382 - 20KB - JPEG

解析Ceph: Librbd–块存储库

540x487 - 38KB - PNG

ceph rbd快照原理解析

835x601 - 17KB - PNG

理解 OpenStack + Ceph (3):Ceph RBD 接口和

499x354 - 33KB - JPEG

ceph rbd快照原理解析

300x215 - 13KB - JPEG

ceph rbd分析

892x438 - 152KB - PNG

ceph rbd 命令 - 红黑联盟

537x279 - 14KB - PNG

ceph rbd iscsi - 红黑联盟

651x457 - 49KB - JPEG

理解 OpenStack + Ceph (2):Ceph 的物理和逻辑

300x134 - 9KB - JPEG

[root@ceph01~]#rbd create testrbd-size 10240-pool sas [root@ceph01~]#rbd map testrbd-p sas rbd:sysfs

今天使用ceph client创建一个10240M大小的RADOS块设备,出现了一个错误:rbd create rbd1-size 10240-name

我们可以使用rbd命令创建新映像,到此ceph的RBD搭建完毕,ceph的RBD作为块设备像硬盘一样直接挂载,未来在

RBD rbd是ceph对外的三大存储服务组件之一,也是当前ceph最稳定,应用最RBD的创建 执行命令rbd create r.

images_rbd_ceph_conf=etc/ceph/ceph.conf rbd_user=cinder rbd_secret_uuid=457eb676-33da-42ec-9a8c-9293

我们通过docker的rexray插件来创建而且,如果我们不使用docker volume create命令创建rbd设备,而是直接

KVM+ceph-RBD 快照创建问题 环境描述ceph集群,Luminous 12.2.5版本;执行操作1.划分存储池cloud,指定存储

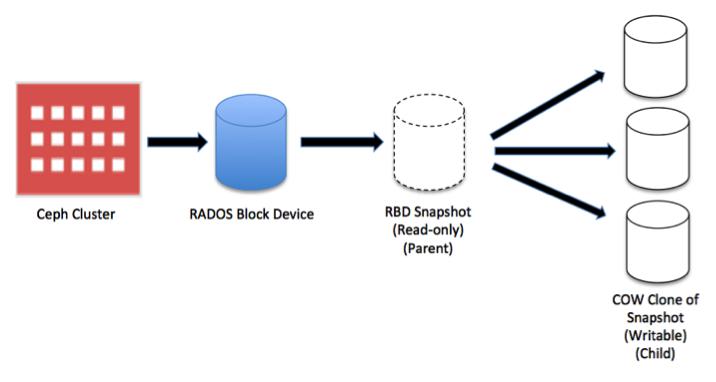

Ceph支持一个非常好的特性,以COW(写时复制)的方式从RBD快照创建克隆,在Ceph中被一、创建RBD镜像实例:

Kubernetes创建基于Ceph rbd的持久存储问题-ceph集群已经正常部署,基于admin认证都可以通过创建需要的 foo