交叉熵损失函数公式_多分类交叉熵损失函数公式

上式即为大名鼎鼎的交叉熵损失函数。(说明:如果熟悉“ E[−logpi]=−∑i=1mpilog 这步需要用到一些简单的对数运算公式,这里先以编号形式给出,下面推导过程中使用特

对应的信息熵等于五比特。有数学基础的读者还可以证明上面公式的值不可能大于五。 交叉熵损失函数可以衡量p与q的相似性。交叉熵作为损失函数还有一个好处是使用sigm

交叉熵代价函数(Cross-entropy cost function)是用来衡量人工神经网络(ANN)的预测值与 其中,z表示神经元的输入, 表示激活函数。从以上公式可以看出,w和b的梯度跟激活函数

交 叉 熵 损 失 函 数 chyang1999|2018-06-30 (高于99%的文档) 马上扫一扫 手机打开 随 为了克服这个缺点,引入了交叉熵代价函数(下面的公式对应一个神经元,多输入 单输出):

并提供了tf.nn.softmax_cross_entropy_with_logits函数。比如可以直接通过以下代码实现了sotfmax回归之后的交叉熵损失函数: cross_entropy=tf.nn.sparse_sotfmax_cross_entro

可能会有读者说,我已经知道了交叉熵损失函数的推导过程。但是能不能从更直观的角度去理解这个表达式呢?而不是仅仅记住这个公式。好问题!接下来,我们从图形的角度,分析

交叉熵损失函数可以衡量p与q的相似性。交叉熵作为损失函数还有一个好处是使用sigm 来求得信息熵。公式如下:H(x) = E[I(xi)] = E[ log(1/p(xi)) ] = -∑p(xi)log(p(xi))其中,x表示随

要解释交叉熵损失函数的意义,我认为应该从熵的根源说起。这里我不介绍熵作者呀,来源呀什么的不再介绍了(主要是懒),哈哈!)这里讲的顺序是:信息量--》信息熵--》交叉熵 如果

交叉熵代价函数(Cross-entropy cost function)是用来衡量人工神经网络(ANN)的预测值与 其中,z表示神经元的输入, 表示激活函数。从以上公式可以看出,w和b的梯度跟激活函数

交叉熵损失函数以及softmax损失函数 2018年08月15日 14:41:30 liye-uestc阅读数:213 交叉熵损失函数以及softmax损失函数 欢迎使用Markdown编辑器写博客 本Markdown编辑

简单易懂的softmax交叉熵损失函数求导

640x475 - 29KB - JPEG

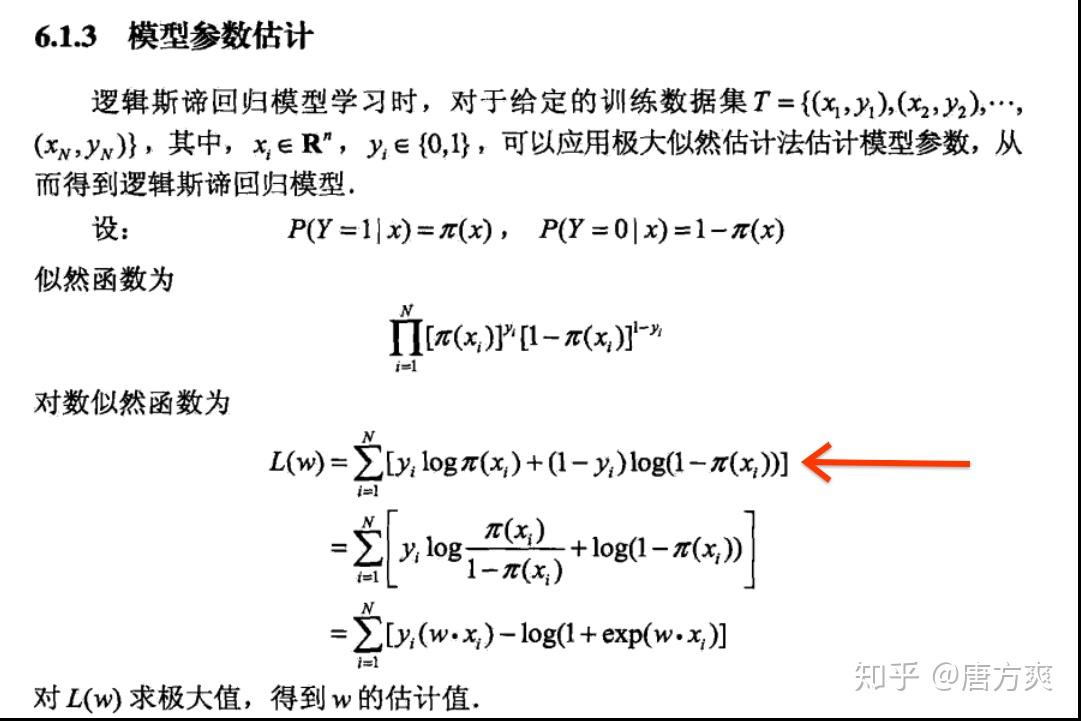

为什么逻辑回归的损失函数叫做交叉熵呢?

1081x721 - 121KB - JPEG

简单易懂的softmax交叉熵损失函数求导

640x475 - 47KB - JPEG

交叉熵损失函数 - 蓝讯

280x220 - 10KB - PNG

为什么逻辑回归中要使用交叉熵损失函数?

222x119 - 2KB - JPEG

不堆砌公式,用最直观的方式带你入门深度学习

550x267 - 22KB - JPEG

斯坦福深度学习课程第七节丨RNN,GRU与LST

516x217 - 104KB - JPEG

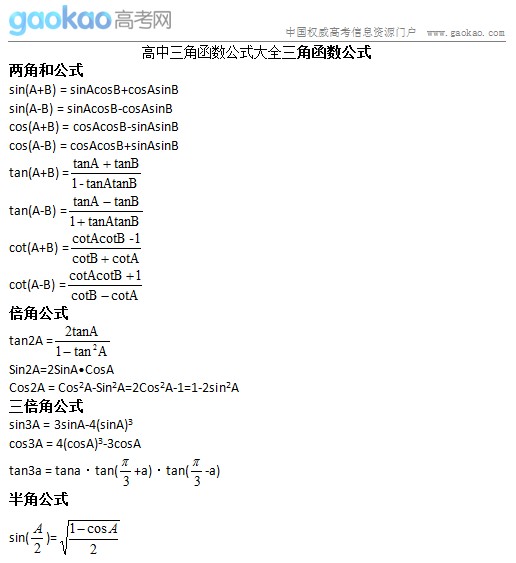

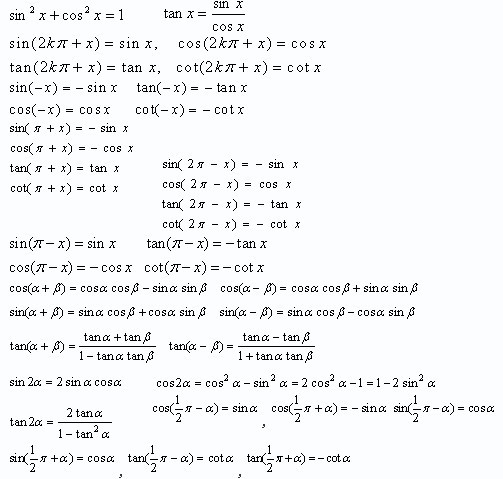

三角函数公式推导过程

538x226 - 24KB - JPEG

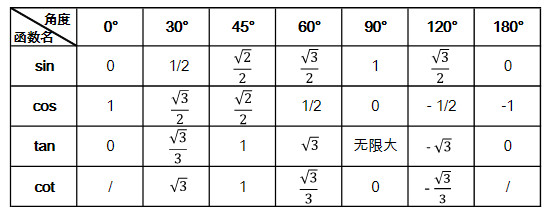

高一必备:高中三角函数公式大全_高考网

516x563 - 53KB - JPEG

高中三角函数公式表 - 教学研究

503x479 - 61KB - JPEG

第三篇 热力学第二定律.pdf

800x1131 - 136KB - PNG

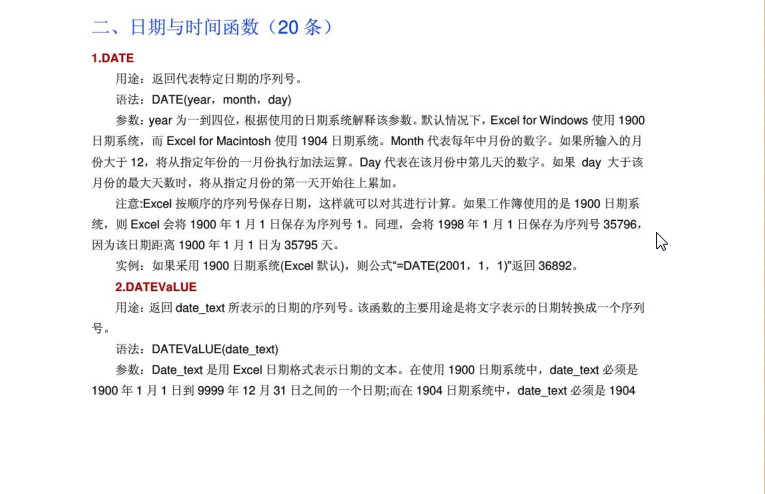

excel函数公式大全会计|Excel财务函数公式大全

765x494 - 79KB - JPEG

初中数学使用频率最高的三角函数公式

557x218 - 30KB - JPEG

山东高考数学知识点三角函数公式表

503x479 - 61KB - JPEG

幂函数公式_课外知识

600x464 - 94KB - PNG