redis 多大数据量_电商大数据的数据量

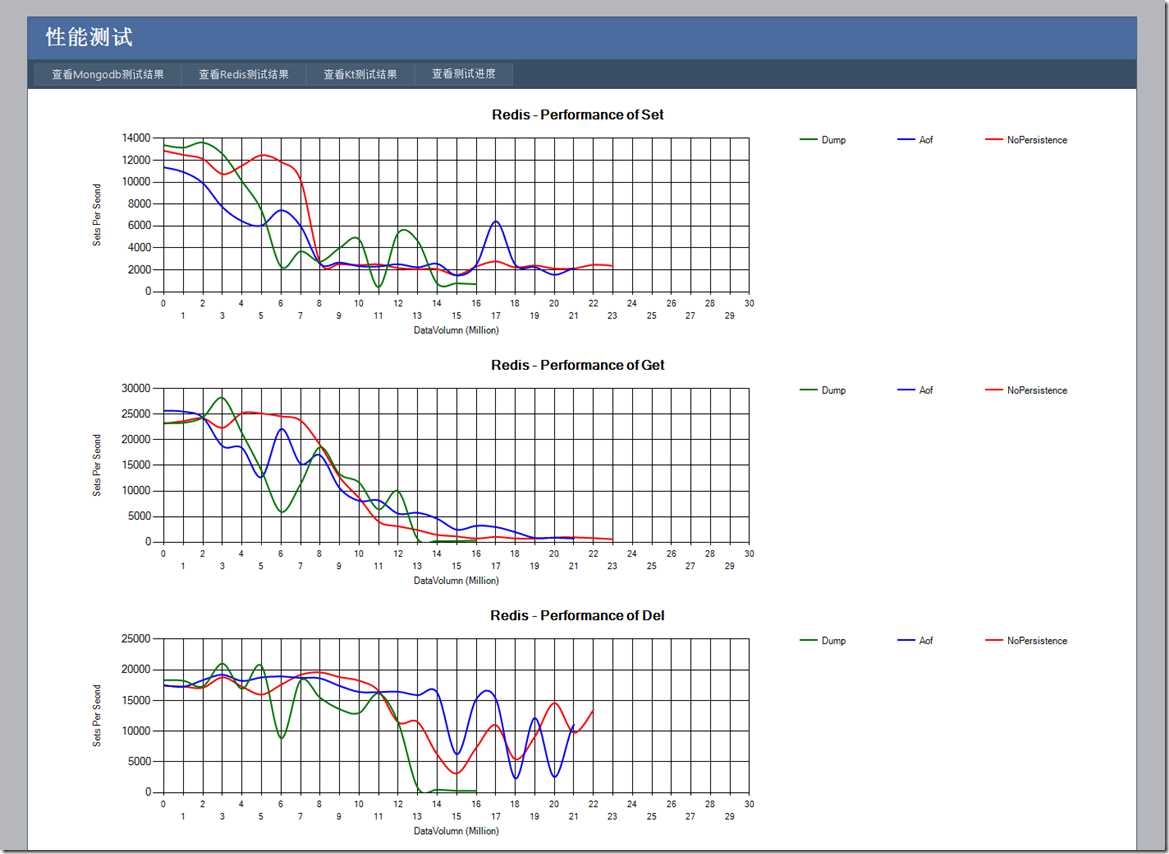

Redis万万级的数据量的性能测试

1169x854 - 166KB - PNG

Redis千万级的数据量的性能测试 - lovecindyw

1169x854 - 196KB - PNG

Redis千万级的数据量的性能测试

1169x854 - 196KB - PNG

![[redis]线上大数据量redis主从一例](https://img0.tuicool.com/Zjiqei.jpg!web)

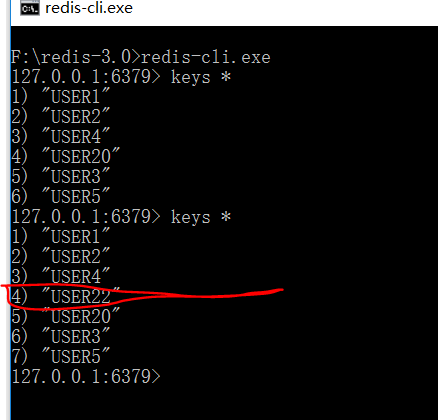

[redis]线上大数据量redis主从一例

550x424 - 18KB - JPEG

![[redis]线上大数据量redis主从一例](https://img0.tuicool.com/26fAni.png!web)

[redis]线上大数据量redis主从一例

395x206 - 22KB - PNG

实例,日均大概40w+个备份文件,40TB+数据量(

1003x739 - 98KB - JPEG

从Redis Lua到Goroutine,日均10亿次的股票行

640x339 - 28KB - JPEG

高性能kv存储之Redis、Redis Cluster、Pika:如

541x527 - 27KB - JPEG

Redis -- Redis架构设计_资讯_突袭网

1107x759 - 164KB - PNG

为什么要使用redis? - 数据库其他综合 - 红黑联

1023x654 - 17KB - PNG

学习Redis你必须了解的数据结构JS实现集合和

329x266 - 30KB - PNG

Spring整合Redis做数据缓存(Windows环境)

438x420 - 29KB - PNG

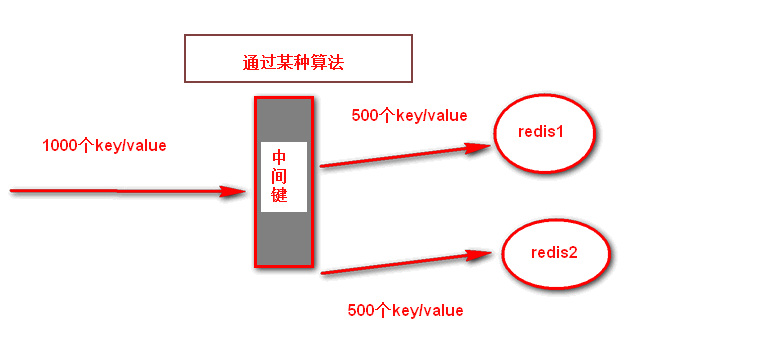

redis分片 - liuconglin - 博客园

772x359 - 9KB - PNG

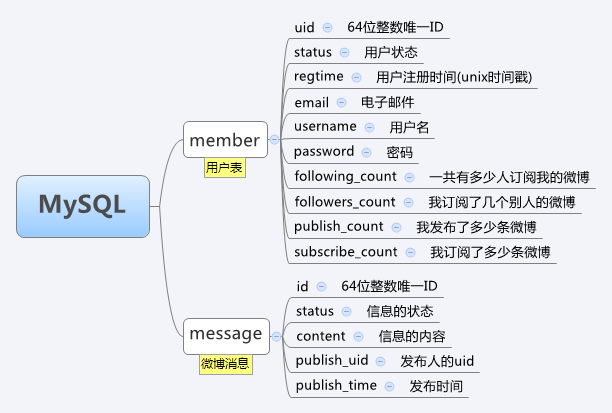

完全用nosql轻松打造千万级数据量的微博系统

612x413 - 36KB - PNG

redis-介绍及安装

553x282 - 100KB - PNG

摘要:Redis千万级的数据量的性能测试 Redis千万级的数据量的性能测试": 关键词:redis 千万 级 数据量

在这样大数据量的频繁查询下,这个场景下,REDIS就派上了用场。用 Redis 缓存客户信息,用 session id 或者

因此在Redis中会有大量过期Key未被及时清理。转载请注明:lxw的大数据田地»关于Redis的数据清理

想将文章标题 md5 后存到 Redis 进行去重, 数据量大概是 90w/月,并且不断累积。想问: (1)服务器大概

在大数据时代,总希望存在一个Key-value存储机制,像HashMap一样在内存中处理大量(千万数量级)的key-

即省去了大量指针的内存开销,这个即大数据量的数据 存储,截止到本文,后两种持久化方式仍然是在实验阶段

如何取出大数据量的 redis hash 结构的数据并遍历导出,解决方案1:/*格式化成输入字符串*@param args*@

使用Redis的脚本功能实现Redis中数据简单查询,有需要的朋友可以参考下。在Redis的设计中,key是一切,对于

大数据时代,海量数据分析就像吃饭一样,成为了我们每天的工作。关键是数据量还特别大,每天几千万很常见。

通过上文描述的方式,我们可以将人口标签和 mapping 数据按照上面的方式去存储,这样的好处就是 redis key